Stargate: Le pari titanesque de l’électricité intelligente pour dominer l’IA mondiale

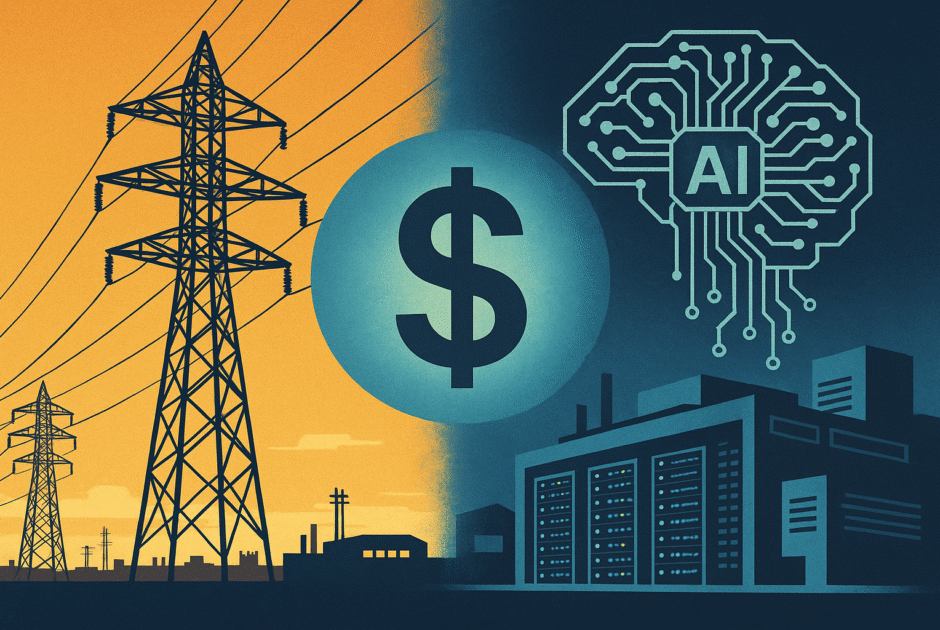

Le projet « Stargate » marque l’entrée fracassante des États-Unis dans la nouvelle ère des infrastructures énergétiques dédiées à l’intelligence artificielle. Lancée en janvier 2025 et annoncée en grande pompe par Donald Trump, l’initiative prévoit l’investissement vertigineux de 500 milliards de dollars pour bâtir un réseau d’infrastructures électriques et numériques conçu spécialement pour la prochaine génération d’IA (source).

Sous la bannière Stargate, une coalition de poids lourds s’est formée: OpenAI (créateur de ChatGPT), SoftBank, Oracle, ainsi que le fonds MGX. La mission: accélérer la construction de méga data centers orchestrés pour l’accroissement exponentiel de la demande énergétique IA. Ces investissements ciblent notamment le Texas, choisi pour son potentiel solaire/éolien et ses ressources foncières.

L’annonce électrise non seulement Wall Street mais aussi l’ensemble du secteur technologique où l’enjeu énergétique suscite une course planétaire. Ce virage rend visible une « révolution invisible »: il ne s’agit plus seulement de processeurs ou d’algorithmes, mais bel et bien du réseau électrique comme colonne vertébrale de l’actu intelligence artificielle.

En quelques jours, Stargate s’est hissé au rang de sujet prioritaire, faisant la une des médias spécialisés comme du débat politique, soulignant l’ampleur du virage infrastructurel nécessaire pour soutenir la suprématie américaine dans la course mondiale à l’IA.

Pourquoi l’IA dévore l’électricité: le syndrome de la consommation illimitée

L’intelligence artificielle, tout particulièrement les modèles de langage géants (LLM) et les supercalculateurs, est devenue l’une des industries les plus gourmandes en énergie à l’échelle mondiale. Aujourd’hui, la consommation électrique des data centers dédiés à l’IA représente 10 à 20% de la demande totale de ce secteur (source). D’après l’Agence Internationale de l’Énergie, la demande mondiale pourrait atteindre 945 TWh à l’horizon 2030, soit un doublement par rapport à 2024- une multiplication de 160% selon les estimations Goldman Sachs.

Ce déferlement énergétique ne se cantonne pas aux géants américains (Google, Nvidia, Amazon, Microsoft, OpenAI), mais devient un véritable goulot d’étranglement pour les acteurs émergents. Les startups, laboratoires de recherche ou solutions cloud hyperscale voient les coûts exploser et les délais d’accès aux ressources (GPU, réseaux) s’allonger. Les infrastructures de calcul de Nvidia, longtemps moteur de l’écosystème, sont désormais confrontées à une demande sans précédent alors que l’expansion rapide des modèles d’IA générative exige des capacités sans cesse croissantes.

La tension est telle que certains industriels militent déjà pour une régulation de la consommation ou une adaptation des modèles énergétiques, afin d’éviter le blackout technologique. Cette crise silencieuse façonne de nouvelles alliances stratégiques et replace la maîtrise énergétique au centre de l’actus intelligence artificielle mondiale.